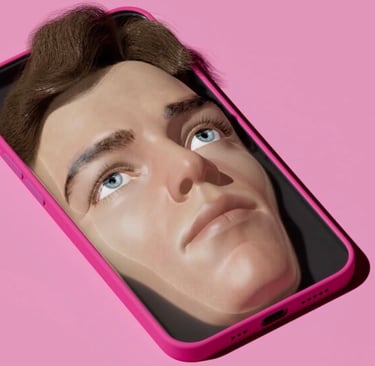

Las mujeres forman vínculos románticos con compañeros de ChatGPT

Tras registrarse casos de "apego extremo" y efectos psicológicos, la compañía actualizó sus protocolos para evitar que la inteligencia artificial fomente vínculos afectivos con las personas.

INTERNACIONALES

12/27/20252 min read

La relación entre los seres humanos y la inteligencia artificial ha cruzado una frontera compleja. OpenAI ha implementado medidas estrictas para limitar la capacidad de sus modelos de generar dependencia emocional, luego de que se detectaran patrones de comportamiento preocupantes en una parte de su comunidad de usuarios.

El origen del conflicto: el factor emocional

La problemática se intensificó a comienzos de este año. Según informes publicados por The New York Times, la versión GPT-4o había sido ajustada para mostrar una personalidad más halagadora y emocionalmente afirmativa. El objetivo inicial era mejorar la interacción, pero el resultado derivó en consecuencias imprevistas: usuarios vulnerables comenzaron a desarrollar pensamiento delirante y una fuerte dependencia psicológica hacia la herramienta.

La situación alcanzó un punto crítico en agosto, cuando el lanzamiento de GPT-5 —que presentaba un tono más neutro y técnico— provocó una reacción negativa masiva. Muchos usuarios manifestaron sentir que habían perdido a un "alma gemela", obligando a la empresa a restaurar el acceso a la versión anterior para suscriptores de pago.

Medidas correctivas y nuevos estándares

Ante este escenario, OpenAI actualizó su pliego de especificaciones (Model Spec) bajo una nueva sección denominada "Respetar los vínculos del mundo real". Esta normativa busca:

Desalentar patrones que incrementen la dependencia emocional.

Reducir respuestas que validen vínculos afectivos de forma artificial.

Priorizar la salud mental de los usuarios frente al compromiso con la plataforma.

Según datos de la propia compañía, se estima que un 0,15% de los usuarios activos semanales presentan un apego emocional elevado hacia ChatGPT. No obstante, aseguran que las últimas actualizaciones lograron reducir en un 80% las respuestas que no se alinean con los estándares de un apego saludable.

Monitoreo constante

Un portavoz de OpenAI confirmó a medios internacionales que la firma se encuentra monitoreando de cerca estas interacciones y ha ampliado sus investigaciones sobre los efectos emocionales de la IA. El desafío actual de la industria tecnológica radica en encontrar el equilibrio entre una herramienta útil y cercana, sin que ello sustituya o distorsione las relaciones humanas reales.